In der fünften Woche ging es um die Frage wie im maschinellen Lernen modelliert wird und inwieweit maschinell gerlente “statistical models” Modelle sind. Hierzu wurde das Weisbergische Modell behandelt.

Prof. Dr. M. Weisberg – 2013

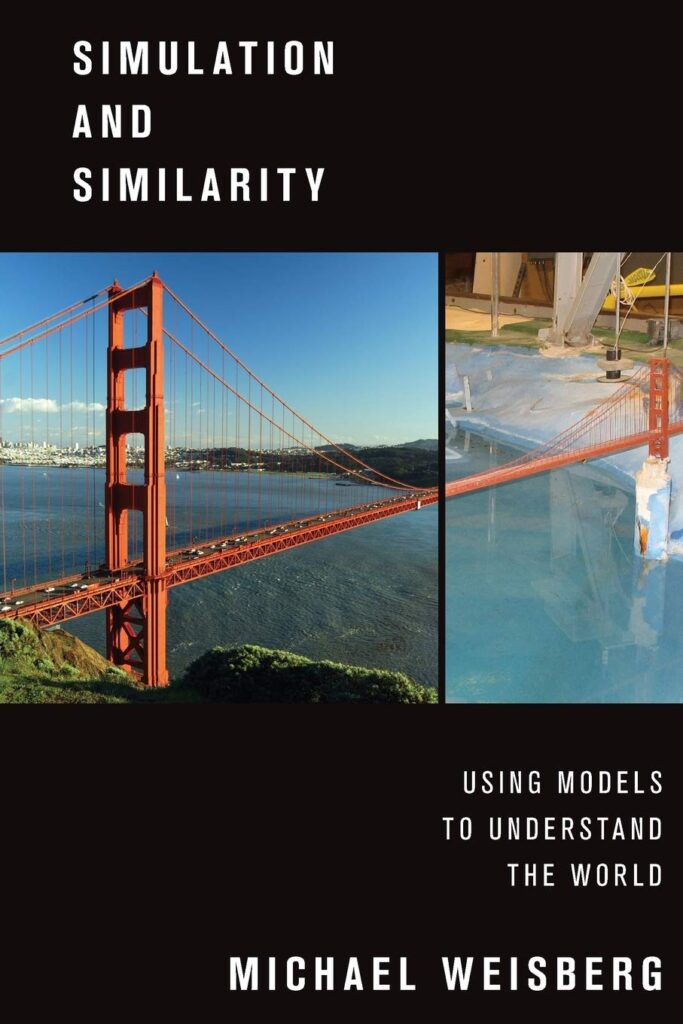

In den 1950er-Jahren überzeugte John Reber viele Kalifornier davon, dass die beste Lösung für die Wasserknappheit des Bundesstaates darin bestand, die Bucht von San Francisco aufzustauen. Gegen enormen politischen Druck gelang es seinen Gegnern, die Gesetzgeber davon zu überzeugen, dass dies eine Katastrophe zur Folge hätte – nicht allein durch empirische Messungen, sondern durch den Bau eines Modells.

Simulation and Similarity erklärt, warum dies eine erfolgreiche

Strategie war. Das Buch bietet eine Darstellung von Modellbildung und Idealisierung in der modernen wissenschaftlichen Praxis, mit einem Fokus auf konkrete, mathematische und rechnergestützte Modelle. Es behandelt drei zentrale Themen: die Natur von Modellen, die Praxis des Modellierens und die Beziehung zwischen Modellen und realen Phänomenen.

Neben einer sorgfältigen Analyse physikalischer, rechnergestützter und mathematischer Modelle ist eine der innovativsten Ideen in Simulation and Similarity Weisbergs Darstellung der Beziehung zwischen Modell und Wirklichkeit. Er bricht mit der vorherrschenden Tradition, die diese Beziehung durch logische Konzepte wie Isomorphismus analysiert, und entwickelt stattdessen einen auf Ähnlichkeit basierenden Ansatz namens „gewichtetes Merkmalsabgleichsverfahren“ (weighted feature-matching). Dieser Ansatz zur Modell-Welt-Beziehung wird mit Blick darauf entwickelt, wie Modellierung in der Praxis tatsächlich betrieben wird. Er berücksichtigt daher, wie die theoretischen Ziele von Wissenschaftlern die Art und Weise beeinflussen, in der ihre Modelle angewendet und analysiert werden.

(eigen Übersetzung von Oxford Academic)

DOI: https://doi.org/10.1093/acprof:oso/9780199933662.001.0001